Sau khi huấn luyện một mô hình tuỳ chỉnh mới, bạn có thể dùng A/B Testing để xem hiệu suất của mô hình mới trong điều kiện thực tế so với mô hình bạn đang dùng. Sau khi xác nhận rằng mô hình mới là một điểm cải tiến, bạn có thể dễ dàng triển khai mô hình mới cho tất cả người dùng mà không cần yêu cầu họ cập nhật ứng dụng.

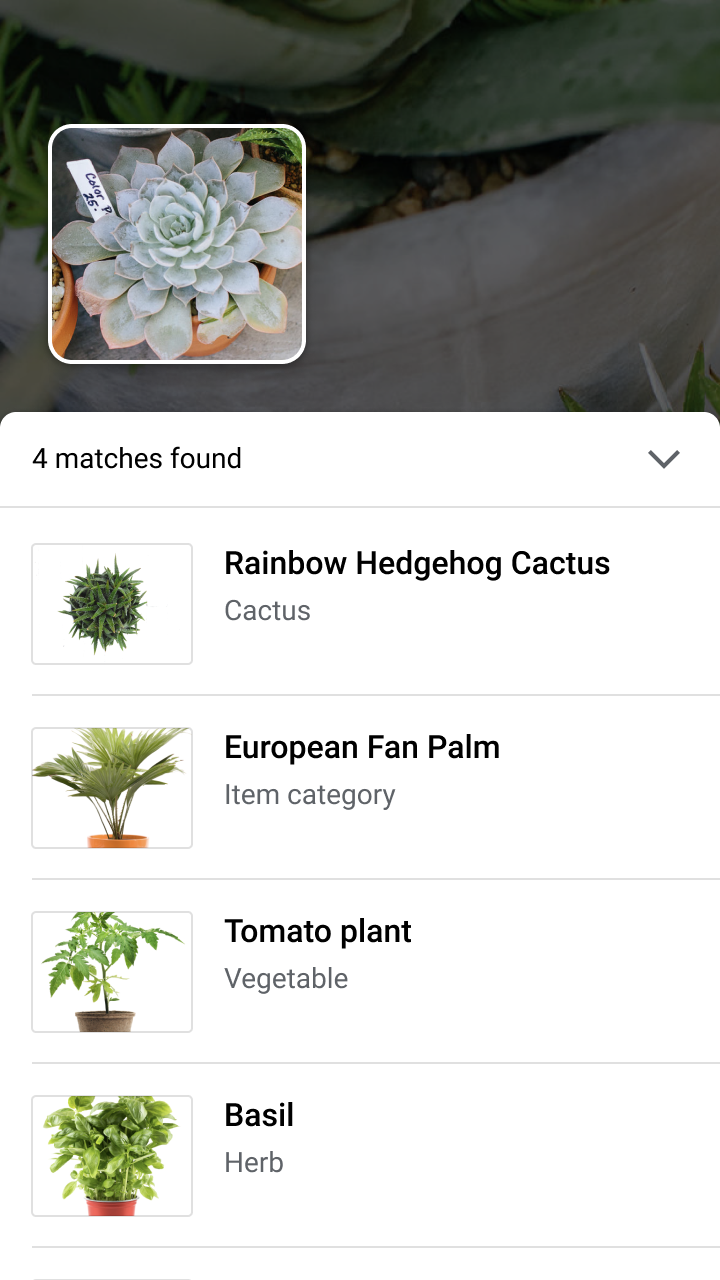

Trang này cho thấy cách bạn có thể tiến hành một thử nghiệm A/B để đánh giá hai phiên bản của một mô hình hỗ trợ tính năng tìm kiếm thực vật bằng hình ảnh giả định. Tính năng này sử dụng một mô hình gắn nhãn hình ảnh tuỳ chỉnh để giúp người dùng xác định các loài thực vật trong hình ảnh.

Giả sử bạn vừa xuất bản một mô hình gắn nhãn thực vật mới, plant_labeler_v2 và bạn muốn chạy một thử nghiệm so sánh mô hình này với mô hình hiện tại của bạn, có tên là plant_labeler_v1. Các bước bên dưới cho biết cách thiết lập, chạy thử nghiệm và hành động dựa trên kết quả.

1. Cho phép định cấu hình mô hình từ xa

Bước đầu tiên để thử nghiệm A/B các mô hình là sửa đổi ứng dụng để sử dụng một tham số Remote Config nhằm xác định mô hình mà ứng dụng sử dụng. Ban đầu, bạn sẽ đặt giá trị mặc định của tham số này là mô hình mà ứng dụng của bạn đã sử dụng, nhưng vì tên mô hình được kiểm soát bằng một tham số có thể định cấu hình từ xa, nên bạn có thể thay đổi và thử nghiệm các mô hình khác nhau mà không cần phải gửi bản cập nhật ứng dụng cho người dùng mỗi lần.

Vì vậy, nếu đã xuất bản mô hình hiện tại của mình dưới tên plant_labeler_v1, thì trong mã khởi chạy ứng dụng, bạn sẽ đặt plant_labeler_v1 làm giá trị mặc định của tham số plant_labeler_model, như trong ví dụ sau:

Kotlin

val remoteConfig = FirebaseRemoteConfig.getInstance()

val remoteConfigDefaults = HashMap<String, Any>()

remoteConfigDefaults["plant_labeler_model"] = "plant_labeler_v1"

Tasks.await(remoteConfig.setDefaultsAsync(remoteConfigDefaults))

remoteConfig.fetchAndActivate().addOnSuccessListener { success ->

if (success) {

// Okay to get remote values.

// ...

}

}

Java

final FirebaseRemoteConfig remoteConfig = FirebaseRemoteConfig.getInstance();

Map<String, Object> remoteConfigDefaults = new HashMap<>();

remoteConfigDefaults.put("plant_labeler_model", "plant_labeler_v1");

Tasks.await(remoteConfig.setDefaultsAsync(remoteConfigDefaults));

remoteConfig.fetchAndActivate().addOnSuccessListener(

new OnSuccessListener<Boolean>() {

@Override

public void onSuccess(Boolean success) {

if (success) {

// Okay to get remote values.

// ...

}

}

});

Sau đó, hãy thay đổi mã thiết lập mô hình để tải mô hình do tham số plant_labeler_model chỉ định:

Kotlin

val rcValue = remoteConfig.getValue("plant_labeler_model")

val remoteModelName = rcValue.asString()

// ...

val remoteModel = FirebaseRemoteModel.Builder(remoteModelName)

.enableModelUpdates(true)

.setInitialDownloadConditions(initialConditions)

.setUpdatesDownloadConditions(updateConditions)

.build()

FirebaseModelManager.getInstance().registerRemoteModel(remoteModel)

// Optionally configure a local model:

// https://firebase.google.com/docs/ml/android/use-custom-models#configure_a_local_model

Java

FirebaseRemoteConfigValue rcValue = remoteConfig.getValue("plant_labeler_model");

String remoteModelName = rcValue.asString();

// ...

FirebaseRemoteModel remoteModel = new FirebaseRemoteModel.Builder(remoteModelName)

.enableModelUpdates(true)

.setInitialDownloadConditions(initialConditions)

.setUpdatesDownloadConditions(updateConditions)

.build();

FirebaseModelManager.getInstance().registerRemoteModel(remoteModel);

// Optionally configure a local model:

// https://firebase.google.com/docs/ml/android/use-custom-models#configure_a_local_model

Giờ đây, khi ứng dụng của bạn sử dụng một tham số Remote Config để xác định mô hình cần tải, bạn có thể thay đổi mô hình chỉ bằng cách xuất bản một mô hình mới và chỉ định tên của mô hình đó cho tham số Remote Config. Tính năng này cho phép A/B Testing chỉ định các mô hình khác nhau cho những người dùng khác nhau nhằm mục đích so sánh.

Trước khi tiếp tục, hãy thêm nội dung sau vào mã tải mô hình xuống:

Kotlin

FirebaseModelManager.getInstance().downloadRemoteModelIfNeeded(remoteModel)

.addOnSuccessListener {

// If the model downloaded was specified by a remote parameter, log an

// event, which will be our experiment's activation event.

if (rcValue.source == FirebaseRemoteConfig.VALUE_SOURCE_REMOTE) {

FirebaseAnalytics.getInstance(this).logEvent("nondefault_model_downloaded", null)

}

}

Java

FirebaseModelManager.getInstance().downloadRemoteModelIfNeeded(remoteModel)

.addOnSuccessListener(new OnSuccessListener<Void>() {

@Override

public void onSuccess(Void aVoid) {

// If the model downloaded was specified by a remote parameter, log an

// event, which will be our experiment's activation event.

if (rcValue.getSource() == FirebaseRemoteConfig.VALUE_SOURCE_REMOTE) {

FirebaseAnalytics.getInstance(YourActivity.this)

.logEvent("nondefault_model_downloaded", null);

}

}

});

Đoạn mã trên ghi lại một sự kiện Analytics tuỳ chỉnh mà bạn sẽ dùng sau này làm

2. Xác định chỉ số mục tiêu

Bước tiếp theo là quyết định cách bạn sẽ đo lường mức độ thành công của mô hình và đảm bảo ứng dụng của bạn đang thu thập dữ liệu cần thiết để kiểm thử mức độ hiệu quả của các phiên bản mô hình theo chỉ số đó.

A/B Testing có một số chỉ số tích hợp, bao gồm doanh thu, mức độ tương tác hằng ngày và tỷ lệ giữ chân người dùng. Những chỉ số này thường hữu ích cho việc kiểm thử các luồng trải nghiệm người dùng khác nhau hoặc tinh chỉnh các tham số, nhưng có thể không phù hợp để đánh giá mô hình và trường hợp sử dụng của bạn. Trong trường hợp này, bạn có thể thử tối ưu hoá cho một sự kiện tuỳ chỉnh trên Analytics.

Lấy ví dụ về tính năng tìm kiếm hình ảnh thực vật giả định, giả sử bạn trình bày kết quả tìm kiếm cho người dùng theo thứ tự độ tin cậy của mô hình đối với từng kết quả. Một cách để bạn có thể biết được độ chính xác của mô hình là xem tần suất người dùng mở kết quả tìm kiếm đầu tiên.

Để kiểm thử xem mô hình nào đạt được mục tiêu tối đa hoá số lượt nhấp vào kết quả hàng đầu, bạn sẽ ghi lại một sự kiện tuỳ chỉnh bất cứ khi nào người dùng nhấn vào mục đầu tiên trong danh sách kết quả.

Kotlin

FirebaseAnalytics.getInstance(this).logEvent("first_result_opened", null)

Java

FirebaseAnalytics.getInstance(YourActivity.this).logEvent("first_result_opened", null);

Chỉ số mà bạn kiểm thử cuối cùng phụ thuộc vào cách ứng dụng của bạn sử dụng mô hình.

Đến đây, bạn có thể triển khai ứng dụng của mình lên Cửa hàng Play. Ứng dụng của bạn sẽ tiếp tục sử dụng mô hình ban đầu, nhưng mã Remote Config và Analytics mà bạn đã thêm sẽ cho phép bạn thử nghiệm với các mô hình khác nhau chỉ bằng cách sử dụng bảng điều khiển Firebase.

3. Chạy thử nghiệm A/B Testing

Giờ đây, khi ứng dụng của bạn đã đến tay người dùng và đang thu thập dữ liệu phân tích, hãy tạo một thử nghiệm A/B Testing để kiểm tra hiệu quả của việc sử dụng mô hình mới thay vì mô hình hiện tại.

Cách tạo thử nghiệm:

-

Trên trang Sự kiện của bảng điều khiển Firebase, hãy xác minh rằng bạn đang ghi nhật ký các sự kiện Analytics có liên quan: sự kiện kích hoạt và chỉ số mục tiêu.

Ứng dụng của bạn cần ghi nhật ký từng sự kiện ít nhất một lần trước khi sự kiện đó xuất hiện trong bảng điều khiển Firebase.

-

Trong bảng điều khiển Firebase, hãy mở mục A/B Testing.

-

Tạo một thử nghiệm mới:

Nhấp vào Tạo thử nghiệm > Remote Config.

-

Trong mục Nhắm mục tiêu:

- Chọn ứng dụng của bạn trong danh sách

- Chỉ định số lượng người dùng mà bạn muốn đưa vào thử nghiệm

- Chọn sự kiện kích hoạt mà bạn đã bắt đầu ghi nhật ký (trong ví dụ này, nondefault_model_downloaded)

-

Trong phần Mục tiêu, hãy chọn chỉ số mục tiêu mà bạn đã xác định trong phần trước (trong ví dụ này, first_result_opened) trong danh sách chỉ số mục tiêu, rồi chọn mọi chỉ số bổ sung mà bạn muốn theo dõi, chẳng hạn như doanh thu từ giao dịch mua hoặc số người dùng không gặp sự cố.

-

Trong mục Biến thể, hãy xác định 2 biến thể:

- Nhóm đối chứng (được tạo tự động)

- Ứng dụng gắn nhãn thực vật thử nghiệm

Đối với Nhóm kiểm soát, hãy tạo một tham số

plant_labeler_modelvà đặt tham số đó thànhplant_labeler_v1. Người dùng được chỉ định vào nhóm đối chứng sẽ sử dụng mô hình cũ. (Không đặt tham số thành(no change), vì trong ứng dụng, bạn đang kiểm thử rằng bạn đang sử dụng một giá trị từ xa.)Đối với biến thể Experimental plant labeler (Trình gắn nhãn thực vật thử nghiệm), hãy đặt tham số

plant_labeler_modelthànhplant_labeler_v2(giả sử bạn đã xuất bản mô hình mới của mình dưới tên đó). Những người dùng được chỉ định cho biến thể này sẽ sử dụng mô hình mới.

Bắt đầu thử nghiệm và chạy thử nghiệm trong vài ngày trở lên, cho đến khi A/B Testing tuyên bố một phiên bản chiến thắng. Nếu thử nghiệm không xác định được biến thể hiệu quả nhất, bạn có thể cần mở rộng thử nghiệm cho nhiều người dùng hơn.

4. Triển khai biến thể hiệu quả nhất cho tất cả người dùng

Sau khi A/B Testing thu thập đủ thông tin để xác định một biến thể dẫn đầu (trong trường hợp này là biến thể tối đa hoá số lượt nhấp vào kết quả tìm kiếm hàng đầu), bạn có thể quyết định xem có nên triển khai biến thể dẫn đầu (hoặc một biến thể khác) cho tất cả người dùng hay không.

Trong mục A/B Testing của bảng điều khiển Firebase, hãy mở chế độ xem chi tiết của thử nghiệm đã hoàn tất. Trong chế độ xem này, bạn có thể xem hiệu suất của từng biến thể theo chỉ số mục tiêu và mọi chỉ số phụ mà bạn đã chọn. Dựa vào thông tin này, bạn có thể quyết định có nên triển khai biến thể hàng đầu hay một biến thể khác.

Để triển khai một biến thể cho tất cả người dùng, hãy nhấp vào more_vert > Triển khai biến thể trên trang thông tin chi tiết của thử nghiệm. Sau khi bạn thực hiện việc này, giá trị của thông số plant_labeler_model sẽ là plant_labeler_v2 đối với tất cả người dùng.

Trong bản cập nhật ứng dụng sau này, bạn nên thay đổi giá trị mặc định của tham số plant_labeler_model thành plant_labeler_v2 và cập nhật mô hình đi kèm nếu bạn sử dụng mô hình. Tuy nhiên, người dùng của bạn đã dùng mô hình mới nhất, vì vậy, bạn có thể đẩy bản cập nhật này trong ứng dụng đã phát hành bất cứ khi nào thuận tiện, chẳng hạn như khi bạn thực hiện bản cập nhật tính năng tiếp theo.