1. Panoramica

Ti diamo il benvenuto nel codelab Classificazione del testo con TensorFlow Lite e Firebase. In questo codelab imparerai a utilizzare TensorFlow Lite e Firebase per addestrare ed eseguire il deployment di un modello di classificazione del testo nella tua app. Questo codelab si basa su questo esempio di TensorFlow Lite.

La classificazione del testo è il processo di assegnazione di tag o categorie al testo in base ai suoi contenuti. È una delle attività fondamentali dell'elaborazione del linguaggio naturale (NLP) con ampie applicazioni, come l'analisi del sentiment, l'etichettatura degli argomenti, il rilevamento dello spam e il rilevamento dell'intent.

L'analisi del sentiment è l'interpretazione e la classificazione delle emozioni (positive, negative e neutre) all'interno dei dati di testo utilizzando tecniche di analisi del testo. L'analisi del sentiment consente alle attività di identificare il sentiment dei clienti nei confronti di prodotti, brand o servizi nelle conversazioni e nei feedback online.

Questo tutorial mostra come creare un modello di machine learning per l'analisi del sentiment, in particolare per classificare il testo come positivo o negativo. Questo è un esempio di classificazione binaria o a due classi, un tipo di problema di machine learning importante e ampiamente applicabile.

Obiettivi didattici

- Addestrare un modello di analisi del sentiment TF Lite con TF Lite Model Maker

- Esegui il deployment dei modelli TF Lite su Firebase ML e accedi da un'app

- Monitorare il feedback degli utenti per misurare l'accuratezza del modello con Firebase Analytics

- Profilare le prestazioni del modello tramite Firebase Performance Monitoring

- Seleziona quale dei vari modelli di cui è stato eseguito il deployment viene caricato tramite Remote Config.

- Sperimenta diversi modelli tramite Firebase A/B Testing

Che cosa ti serve

- Xcode 11 (o versioni successive)

- CocoaPods 1.9.1 o versioni successive

Come utilizzerai questo tutorial?

Come valuteresti la tua esperienza di creazione di app per Android?

2. Crea un progetto nella console Firebase

Aggiungi Firebase al progetto

- Vai alla Console Firebase.

- Seleziona Crea nuovo progetto e assegna al progetto il nome "Firebase ML iOS Codelab".

3. Ottieni il progetto di esempio

Scarica il codice

Inizia clonando il progetto di esempio ed eseguendo pod update nella directory del progetto:

git clone https://github.com/FirebaseExtended/codelab-textclassification-ios.git cd codelab-textclassification-ios pod install --repo-update

Se non hai installato git, puoi anche scaricare il progetto di esempio dalla relativa pagina GitHub o facendo clic su questo link. Dopo aver scaricato il progetto, eseguilo in Xcode e prova la classificazione del testo per capire come funziona.

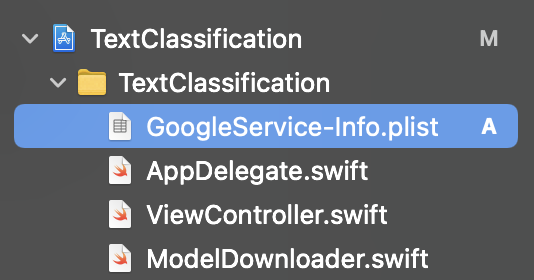

Configura Firebase

Segui la documentazione per creare un nuovo progetto Firebase. Una volta creato il progetto, scarica il file GoogleService-Info.plist del progetto dalla console Firebase e trascinalo nella root del progetto Xcode.

Aggiungi Firebase al tuo podfile ed esegui pod install.

pod 'FirebaseMLModelDownloader', '9.3.0-beta'

Nel metodo didFinishLaunchingWithOptions di AppDelegate, importa Firebase all'inizio del file

import FirebaseCore

e aggiungi una chiamata per configurare Firebase.

FirebaseApp.configure()

Esegui di nuovo il progetto per assicurarti che l'app sia configurata correttamente e non si arresti in modo anomalo all'avvio.

4. Addestrare un modello di analisi del sentiment

Utilizzeremo TensorFlow Lite Model Maker per addestrare un modello di classificazione del testo per prevedere il sentiment di un determinato testo.

Questo passaggio viene presentato come un notebook Python che puoi aprire in Google Colab.

Apri in Colab

Al termine di questo passaggio, avrai un modello di analisi del sentiment TensorFlow Lite pronto per il deployment in un'app mobile.

5. Esegui il deployment di un modello in Firebase ML

Il deployment di un modello in Firebase ML è utile per due motivi principali:

- Possiamo mantenere ridotte le dimensioni di installazione dell'app e scaricare il modello solo se necessario

- Il modello può essere aggiornato regolarmente e con un ciclo di rilascio diverso rispetto all'intera app

Il modello può essere implementato tramite la console o in modo programmatico utilizzando l'SDK Admin Firebase. In questo passaggio, eseguiremo il deployment tramite la console.

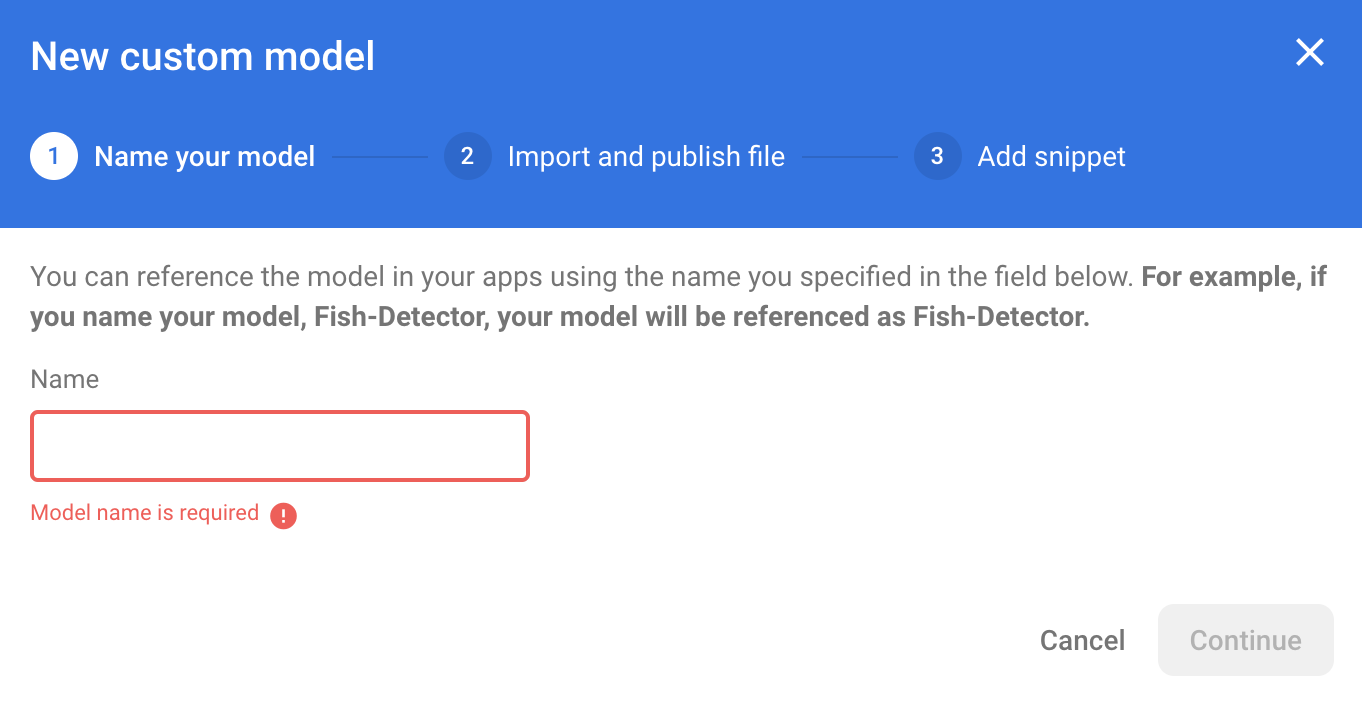

Innanzitutto, apri la console Firebase e fai clic su Machine Learning nel pannello di navigazione a sinistra. Fai clic su "Inizia" se è la prima volta che apri questa pagina. Poi vai a "Personalizzato" e fai clic sul pulsante "Aggiungi modello".

Quando ti viene richiesto, assegna al modello il nome sentiment_analysis e carica il file che hai scaricato da Colab nel passaggio precedente.

6. Scaricare il modello da Firebase ML

Scegliere quando scaricare il modello remoto da Firebase nella tua app può essere complicato, poiché i modelli TFLite possono diventare relativamente grandi. Idealmente, vogliamo evitare di caricare il modello immediatamente all'avvio dell'app, perché se il nostro modello viene utilizzato per una sola funzionalità e l'utente non la usa mai, avremo scaricato una quantità significativa di dati senza motivo. Possiamo anche impostare opzioni di download come il recupero dei modelli solo quando è disponibile una connessione Wi-Fi. Se vuoi assicurarti che il modello sia disponibile anche senza una connessione di rete, è importante raggrupparlo anche senza l'app come backup.

Per semplicità, rimuoveremo il modello in bundle predefinito e scaricheremo sempre un modello da Firebase all'avvio dell'app per la prima volta. In questo modo, quando esegui l'analisi del sentiment, puoi essere certo che l'inferenza venga eseguita con il modello fornito da Firebase.

Nella parte superiore di ModelLoader.swift, importa il modulo Firebase.

import FirebaseCore import FirebaseMLModelDownloader

Poi implementa i seguenti metodi.

static func downloadModel(named name: String,

completion: @escaping (CustomModel?, DownloadError?) -> Void) {

guard FirebaseApp.app() != nil else {

completion(nil, .firebaseNotInitialized)

return

}

guard success == nil && failure == nil else {

completion(nil, .downloadInProgress)

return

}

let conditions = ModelDownloadConditions(allowsCellularAccess: false)

ModelDownloader.modelDownloader().getModel(name: name, downloadType: .localModelUpdateInBackground, conditions: conditions) { result in

switch (result) {

case .success(let customModel):

// Download complete.

// The CustomModel object contains the local path of the model file,

// which you can use to instantiate a TensorFlow Lite classifier.

return completion(customModel, nil)

case .failure(let error):

// Download was unsuccessful. Notify error message.

completion(nil, .downloadFailed(underlyingError: error))

}

}

}

In ViewController.swift's viewDidLoad, sostituisci la chiamata a loadModel() con il nostro nuovo metodo di download del modello.

// Download the model from Firebase

print("Fetching model...")

ModelLoader.downloadModel(named: "sentiment_analysis") { (customModel, error) in

guard let customModel = customModel else {

if let error = error {

print(error)

}

return

}

print("Model download complete")

// TODO: Initialize an NLClassifier from the downloaded model

}

Esegui di nuovo l'app. Dopo qualche secondo, in Xcode dovrebbe essere visualizzato un log che indica che il modello remoto è stato scaricato correttamente. Prova a digitare del testo e verifica che il comportamento dell'app non sia cambiato.

7. Integrare il modello nell'app

La libreria TensorFlow Lite Task ti aiuta a integrare i modelli TensorFlow Lite nella tua app con poche righe di codice. Inizializzeremo un'istanza TFLNLClassifier utilizzando il modello TensorFlow Lite scaricato da Firebase. Poi lo utilizzeremo per classificare l'input di testo degli utenti dell'app e mostrare il risultato nell'interfaccia utente.

Aggiungi la dipendenza

Vai al Podfile dell'app e aggiungi la libreria di attività TensorFlow Lite (testo) nelle dipendenze dell'app. Assicurati di aggiungere la dipendenza nella dichiarazione target 'TextClassification'.

pod 'TensorFlowLiteTaskText', '~> 0.2.0'

Esegui pod install per installare la nuova dipendenza.

Inizializzare un classificatore di testo

Caricheremo quindi il modello di analisi del sentiment scaricato da Firebase utilizzando NLClassifier della libreria delle attività.

ViewController.swift

Dichiariamo una variabile di istanza TFLNLClassifier. Nella parte superiore del file, importa la nuova dipendenza:

import TensorFlowLiteTaskText

Trova questo commento sopra il metodo che abbiamo modificato nell'ultimo passaggio:

// TODO: Add a TFLNLClassifier property.

Sostituisci TODO con il seguente codice:

private var classifier: TFLNLClassifier?

Inizializza la variabile textClassifier con il modello di analisi del sentiment scaricato da Firebase. Trova questo commento che abbiamo aggiunto nell'ultimo passaggio:

// TODO: Initialize an NLClassifier from the downloaded model

Sostituisci TODO con il seguente codice:

let options = TFLNLClassifierOptions()

self.classifier = TFLNLClassifier.nlClassifier(modelPath: customModel.path, options: options)

Classificare il testo

Una volta configurata l'istanza classifier, puoi eseguire l'analisi del sentiment con una singola chiamata al metodo.

ViewController.swift

Nel metodo classify(text:), trova il commento TODO:

// TODO: Run sentiment analysis on the input text

Sostituisci il commento con il seguente codice:

guard let classifier = self.classifier else { return }

// Classify the text

let classifierResults = classifier.classify(text: text)

// Append the results to the list of results

let result = ClassificationResult(text: text, results: classifierResults)

results.append(result)

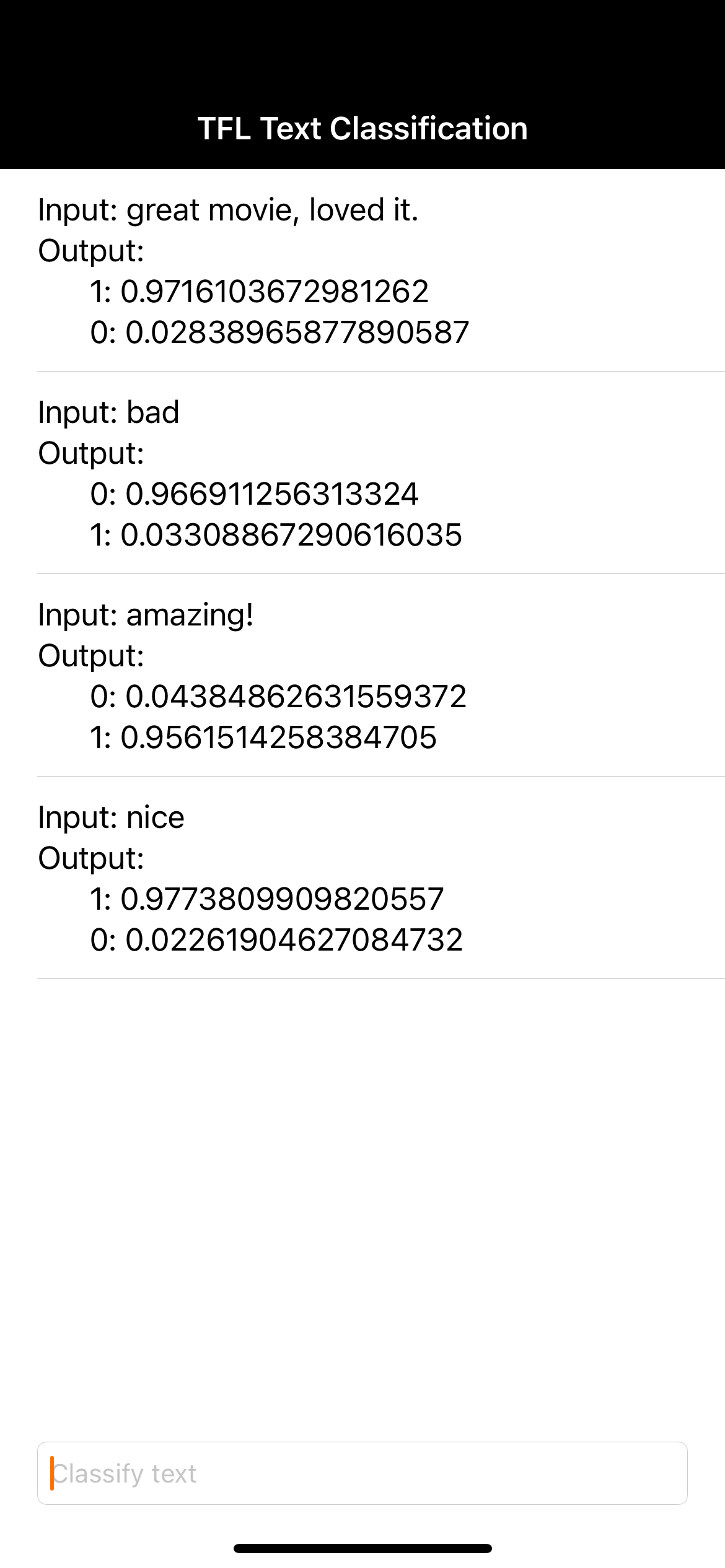

8. Esegui l'app finale

Hai integrato il modello di analisi del sentiment nell'app, quindi testiamolo. Collega il dispositivo iOS e fai clic su Esegui (  ) nella barra degli strumenti di Xcode.

) nella barra degli strumenti di Xcode.

L'app deve essere in grado di prevedere correttamente il sentimento della recensione del film che inserisci.

9. Migliora l'app con altre funzionalità di Firebase

Oltre a ospitare i tuoi modelli TFLite, Firebase offre diverse altre funzionalità per potenziare i tuoi casi d'uso del machine learning:

- Firebase Performance Monitoring per misurare la velocità di inferenza del modello in esecuzione sul dispositivo degli utenti.

- Firebase Analytics per misurare il rendimento del modello in produzione misurando la reazione degli utenti.

- Firebase A/B Testing per testare più versioni del modello

- Ricordi che in precedenza abbiamo addestrato due versioni del nostro modello TFLite? Il test A/B è un buon modo per scoprire quale versione ha un rendimento migliore in produzione.

Per scoprire di più su come sfruttare queste funzionalità nella tua app, consulta i codelab di seguito:

10. Complimenti!

In questo codelab hai imparato ad addestrare un modello TFLite di analisi del sentiment e a eseguirne il deployment nella tua app mobile utilizzando Firebase. Per saperne di più su TFLite e Firebase, dai un'occhiata ad altri esempi di TFLite e alle guide Per iniziare di Firebase.

Argomenti trattati

- TensorFlow Lite

- Firebase ML

Passaggi successivi

- Misura la velocità di inferenza del modello con Firebase Performance Monitoring.

- Esegui il deployment del modello da Colab direttamente su Firebase tramite l'API Firebase ML Model Management.

- Aggiungi un meccanismo per consentire agli utenti di fornire feedback sul risultato della previsione e utilizza Firebase Analytics per monitorare il feedback degli utenti.

- Esegui test A/B del modello Average Word Vector e del modello MobileBERT con Firebase A/B Testing.

Scopri di più

- Documentazione di Firebase Machine Learning

- Documentazione di TensorFlow Lite

- Misurare il rendimento dell'app con Firebase

- Modelli di test A/B con Firebase